法律でも、倫理でもないもの。

2018年3月、米テスラ・モーターズの自動運転車が衝突事故を起こし、ドライバーが死亡した。テスラは、オートパイロットと呼ばれる半自動運転機能での走行中、ドライバーが数度の警告を無視してハンドルを握らなかったことが事故の直接の原因だと主張している。

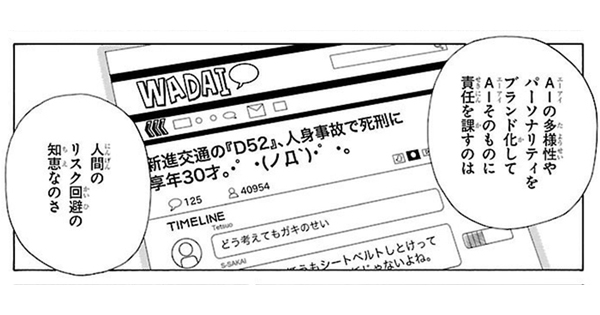

今回の一件に限らず、自動運転車による事故では常にその「責任の所在」が議論される。責任はドライバーにあるのか、自動車メーカーにあるのか、いずれでもないのか。あるとしたらその比率はどのように判断・決定されるべきなのか。

この問題に関して、AIが社会のインフラとなった未来を描いたSF漫画『AIの遺電子』がテーマとして扱っているので紹介したい。掲載紙である『週刊少年チャンピオン』の2017年6月1日号、つまり今から約1年前に発表された作品だ(単行本7巻収録)。

※記事中の作品画像については著者・出版社の許可を得て使用しています。

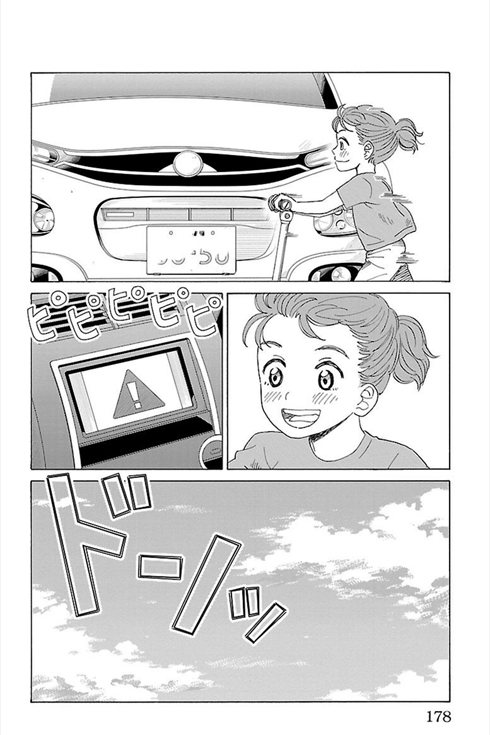

母と子を乗せた自動運転車が人身事故を起こす。この時代の自動運転AIはメーカーや世代ごとに「個性」があり、それぞれに事故を防ぐための判断や行動も異なる。メーカーは事故を起こしたAIを「抹消」することで、事態の収束をはかろうとする。

『何にせよ乗客が責められることはないです 事故を起こしたAIを除籍して終わりでしょう』

『AIの多様性やパーソナリティをブランド化してAIそのものに責任を課すのは 人間のリスク回避の知恵なのさ』

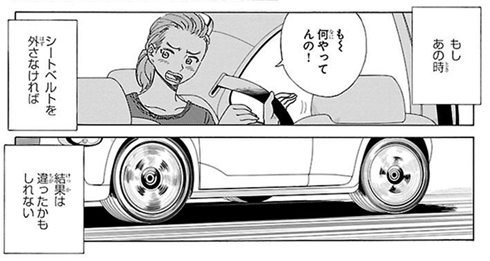

しかし、母親は事故の瞬間に、自分と自分の子が犯したある“失敗”(とも言えないほど小さな判断ミス)を悔いている。

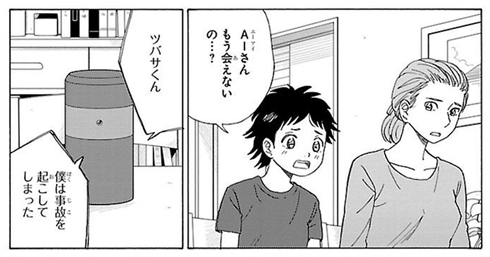

『AIさん もう会えないの……?』

『ツバサくん 僕は事故を起こしてしまった』

『みんなが安心して暮らすために 僕はいなくならなければ』

囲碁や将棋など限られた盤面、ルールの中で行われる判断とは異なり、自動車の運転のような複雑な状況判断が絡む振る舞いには、唯一絶対の正解はない。

現在は、(少なくとも建前上は)「人間の運転をAIがサポートする」という構図だが、段階を踏んで徐々に「AIの運転を人間がサポートする」「人間の介入がない方が安全性が高くなる」と進んでいくのは既定路線と言ってもいいだろう。そうなったときに、人間に責任を求めることは難しくなる。

だが、いかに責任を問われなかろうと、人の心のうちには“引っ掛かるもの”が残る。「あるAIの結末」は、法律上の問題でもなく、倫理上の問題というには少し大げさかもしれない――けれど決して無視できない側面を、丁寧にすくいとって描いている。

特別掲載:『AIの遺電子』第76話 「あるAIの結末」