発話や筆談が困難な人に向けた、コミュニケーション技術としての応用も進められています。

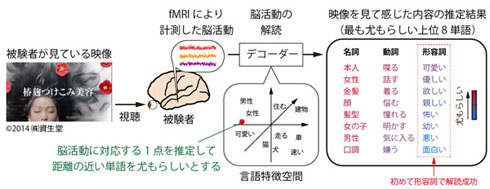

情報通信研究機構(NICT)が、脳が映像から感じた内容を読み解き、名詞・動詞・形容詞の形で言語化する「脳情報デコーディング技術」の開発に成功しました。例えば、被験者がCMを見たときに感じたことを推定し、「女性」「走る」「優しい」といった言葉として出力します。

過去にも同様の試みがなされたことはありましたが、脳から解読できた内容は約500語。今回は1万語に対応する内容が解読できるようになり、さらに従来はできなかった、「印象」を形容詞として読み解くことが可能となりました。

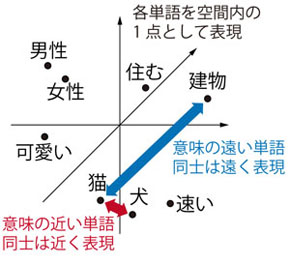

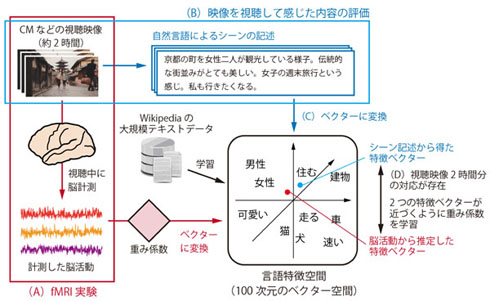

開発においては、脳活動の解読装置であるデコーダーに、大規模なテキストデータから学習された「言語特徴空間」を導入。言語特徴空間では1万語の単語が、意味的な近さ・遠さをもとにして100次元の座標上に配されています。

被験者が映像を見ると、脳の反応が言語特徴空間のどの位置に対応するかデコーダーが解読。座標上で一番近い単語を「もっともらしい」言葉として抽出し、映像を見て感じた内容の推定結果として出力します。

同技術は既に2016年度よりNICTからNTTデータへライセンス提供され、CMなどの映像コンテンツ評価サービスに用いられています。今後は精度の向上を目指すとともに、推定された脳活動の内容がどのように個性や購買行動と結びつくのかといった点についても検証が行われる予定。また、発話や筆談が困難な人に向け、発話を介しないコミュニケーション技術としての応用も進められています。

(沓澤真二)