腕時計型端末が読み取った心拍数などのデータと、会話の言葉を組み合わせてAIが分析。

会話で発せられる言葉は、抑揚や語気などによって意味合いが変わってくるものです。こうした要素を含めて会話の内容を解析し、込められた感情を可視化するアプリを、MIT(マサチューセッツ工科大学)が発表しました。

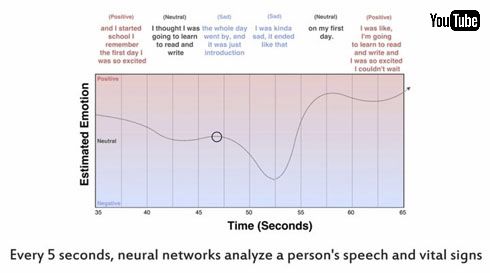

サムスンのリストバンド型生体センサー開発用ハード「Simband」を用いて制作されたアプリ。端末が計測した装着者の動きや心拍数、皮膚温度といった生理学的信号と、話された言葉とその語調など、会話を構成するさまざまな要素をAIが分析します。これをもとに、会話の内容がポジティブかネガティブかといった度合いを、5秒おきにリアルタイムで表示。実験動画を見ると、会話の内容に即して感情のグラフが上下する様子がよくわかります。

実験の結果、会話全体のトーンを83%の精度で判断できたとのこと。アプリは開発途上で、研究チームは今後も大規模なデータ収集を行う予定。さらにApple Watchなど商用デバイスを用いた、世界中で簡単に利用できるシステムを計画しています。

(沓澤真二)